La frase che sentiamo più spesso da clienti che si avvicinano all'AI per la prima volta è una versione di questa: "ma figurati, qualche email anonimizzata che gli passo, mica è un problema serio". Quasi sempre il problema c'è. Quasi sempre nessuno se n'è accorto perché non è successo niente. Quasi sempre "non è successo niente" significa "non l'abbiamo ancora visto succedere".

Il quadro normativo del 2026 sui trasferimenti internazionali di dati personali, in particolare verso provider di AI generativa con server negli Stati Uniti, è più ostile di quanto la maggior parte delle aziende italiane immagini. Non è un articolo per spaventare: è un articolo per mettere ordine. Cosa puoi fare, cosa devi documentare, cosa rischi se non lo fai.

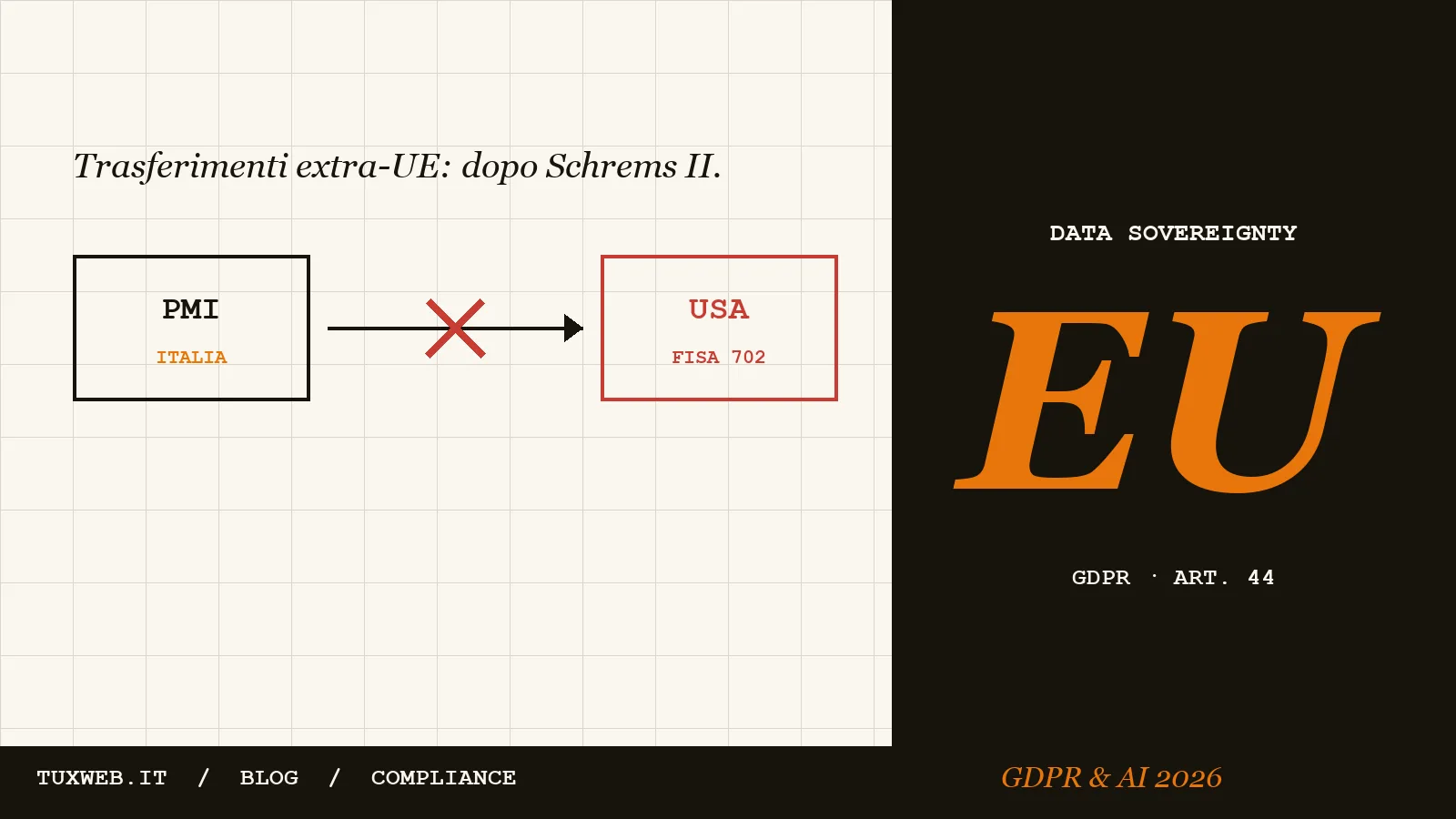

Il punto di partenza: Schrems II, ancora vivo nel 2026

La sentenza CGUE C-311/18 del 16 luglio 2020 ("Schrems II") ha invalidato il Privacy Shield e ha stabilito che i trasferimenti di dati personali verso paesi terzi richiedono garanzie adeguate. Per gli USA, l'analisi della Corte ha messo in luce un problema strutturale: la legislazione americana sulla sorveglianza (FISA 702, EO 12333) consente alle agenzie federali un accesso ai dati che il diritto UE considera incompatibile con il GDPR.

Da allora la Commissione Europea ha approvato il Data Privacy Framework (DPF), in vigore dal luglio 2023, che reintroduce un meccanismo di adeguatezza per i trasferimenti verso aziende USA certificate nel framework. È il sistema che oggi permette in pratica a tantissime aziende europee di usare servizi cloud americani senza dover firmare clausole contrattuali tipo (SCC) caso per caso.

Importante: il DPF non è una garanzia eterna. Schrems sta già preparando un terzo ricorso. Le grandi associazioni di consumatori europee considerano probabile che la CGUE ne dichiari l'invalidità entro 2-3 anni. Costruire una compliance basata solo sul DPF è una scommessa.

OpenAI, Anthropic, Google: cosa fai quando li chiami

Quando il tuo prodotto chiama un'API di un fornitore AI americano:

- I dati del prompt (testo + eventuali file) viaggiano verso server, in genere, negli USA.

- Il provider è il responsabile del trattamento, tu (o la tua azienda) sei il titolare.

- Sei tu che devi: avere base giuridica per il trattamento, informare gli interessati, nominare il provider come responsabile esterno, firmare DPA, valutare il trasferimento.

Tutti i grandi provider (OpenAI, Anthropic, Google, Microsoft) hanno DPA standard e sono certificati DPF. Quindi sulla carta, il trasferimento è coperto. Sulla carta. Nella pratica:

Le tre categorie di rischio per la tua azienda

1. Dati personali ordinari (basso rischio operativo)

Nomi, indirizzi email professionali, numeri di telefono aziendali, contenuto di email B2B prive di particolari dettagli. Trasferimento via DPF generalmente accettabile. Necessario: informativa aggiornata che menzioni il provider, base giuridica solida (di solito legittimo interesse), DPA firmato.

2. Dati relativi a clienti finali / terzi non aziendali (rischio medio-alto)

Se la tua azienda gestisce dati di clienti privati (es. immobiliare residenziale, e-commerce B2C, healthcare, studi legali con persone fisiche): qui il rischio reputazionale e sanzionatorio sale. Necessario: DPIA (valutazione d'impatto), informativa specifica per gli interessati, possibile valutazione di alternative europee, attenzione alle scelte di anonimizzazione/pseudonimizzazione.

3. Dati particolari (art. 9 GDPR) e dati di minori (rischio alto)

Salute, biometria, dati sindacali, opinioni politiche, religione, vita sessuale. Dati di minori. Per questi categorie, il Garante italiano è stato esplicito in più provvedimenti del 2024–2026: il trasferimento extra-UE richiede garanzie supplementari rispetto al solo DPF. In pratica significa: cifratura end-to-end con chiave non disponibile al provider, oppure architettura on-premise / EU-only.

Le sanzioni recenti che vale la pena ricordare

Non per fare terrorismo: per dare un'idea della direzione di marcia.

- Garante italiano vs OpenAI (dicembre 2024): 15 milioni di euro per trattamento illecito di dati personali nell'addestramento di ChatGPT, mancata informazione agli utenti, mancata verifica dell'età.

- Garante italiano vs Replika (febbraio 2025): 5 milioni di euro per analoghi profili.

- CNIL francese vs OpenAI (settembre 2025): 25 milioni di euro per uso di dati di utenti europei senza adeguata trasparenza.

- EDPB linee guida 2/2025: chiarimenti su quando un fornitore di AI generativa va considerato titolare autonomo per i dati che riceve nei prompt.

Per le aziende italiane che usano questi servizi (cioè: sono titolari del trattamento sui propri dati che inviano al provider) il rischio sanzionatorio diretto è inferiore, ma esiste. Soprattutto: cresce con la dimensione del trattamento. Per un'agenzia con 200 clienti i cui dati passano in pipeline AI ogni giorno, una contestazione del Garante è uno scenario realistico, non remoto.

"Abbiamo ricevuto un audit del Garante sull'uso di un servizio cloud per analisi documenti. Non siamo stati sanzionati ma ci sono volute 6 settimane di lavoro del DPO + legale per produrre la documentazione richiesta. Nessuna delle nostre AI proprietarie su infrastruttura italiana è stata oggetto di rilievi." — un nostro cliente del settore healthcare, gennaio 2026.

Cinque opzioni concrete per ridurre l'esposizione

- Anonimizzazione robusta prima dell'invio. Per molti casi d'uso (riassunto, classificazione, traduzione) si possono rimuovere o pseudonimizzare i dati personali a monte. Esistono librerie open source (es. Microsoft Presidio) che fanno entity recognition + masking. Non risolve tutto ma riduce categoricamente il rischio.

- Provider con region UE-only (Microsoft Azure OpenAI Service). Microsoft offre region europee che, contrattualmente, mantengono i dati nell'UE. Non è equivalente a un'infrastruttura italiana — Microsoft è ancora soggetta a leggi USA su richieste delle autorità — ma è un livello in più rispetto all'API standard di OpenAI.

- Modelli open-weight su infrastruttura europea. Llama 3.x, Mistral, Qwen girano benissimo su server italiani o europei. Per molti casi d'uso (assistente interno, RAG aziendale, ticket routing) la qualità è equivalente ai frontier model. Costo iniziale più alto, esposizione legale crollata.

- Architettura ibrida con gating. Default: tutto rimane locale. Solo per casi che richiedono un modello frontier (es. ragionamento avanzato), un router decide di chiamare il provider esterno — ma solo dopo aver fatto passare il dato attraverso uno strato di redaction automatica. Più complesso ma mantiene il meglio dei due mondi.

- Documentazione: DPIA, registro dei trattamenti aggiornato, informativa specifica. Anche se decidi di usare un provider USA, se la documentazione è completa il Garante difficilmente sanziona — sanziona la mala fede o l'omissione, non la scelta tecnologica in sé.

Perché contiamo sull'infrastruttura sovrana

Quando abbiamo progettato Celeris, Nexus e Automata abbiamo fatto una scelta di posizionamento esplicita: infrastruttura italiana, modelli open-weight, dati che non escono dal data center del cliente. Non perché "fa figo" o per ideologia anti-USA. Per un motivo più banale: per molte aziende italiane, soprattutto in healthcare, legal, finance, manifattura sensibile, è la scelta che elimina una categoria intera di problemi di compliance.

Non è la risposta giusta per tutti. Per chi tratta dati a basso rischio in modo non massivo, un provider USA via DPF, ben documentato, è una scelta legittima ed economica. Ma quando il rischio sale — per natura dei dati, per volumi, per esposizione regolatoria — l'infrastruttura sovrana smette di essere un vezzo e diventa la cosa che ti permette di dormire la notte.

Il GDPR del 2026 non vieta l'AI. Pretende che tu sappia cosa stai facendo e che lo abbia messo per iscritto. Le aziende che si attrezzano adesso saranno quelle che, fra 18 mesi, quando il successore del DPF sarà sotto pressione legale, non dovranno cambiare l'architettura di corsa.

Disclaimer: questo articolo offre orientamento operativo, non costituisce consulenza legale. Per scelte concrete sul trattamento dei dati, consultate sempre il vostro DPO o un legale specializzato in privacy.